Yapay Zekanın İki Yüzü: Faydalar ve Riskler

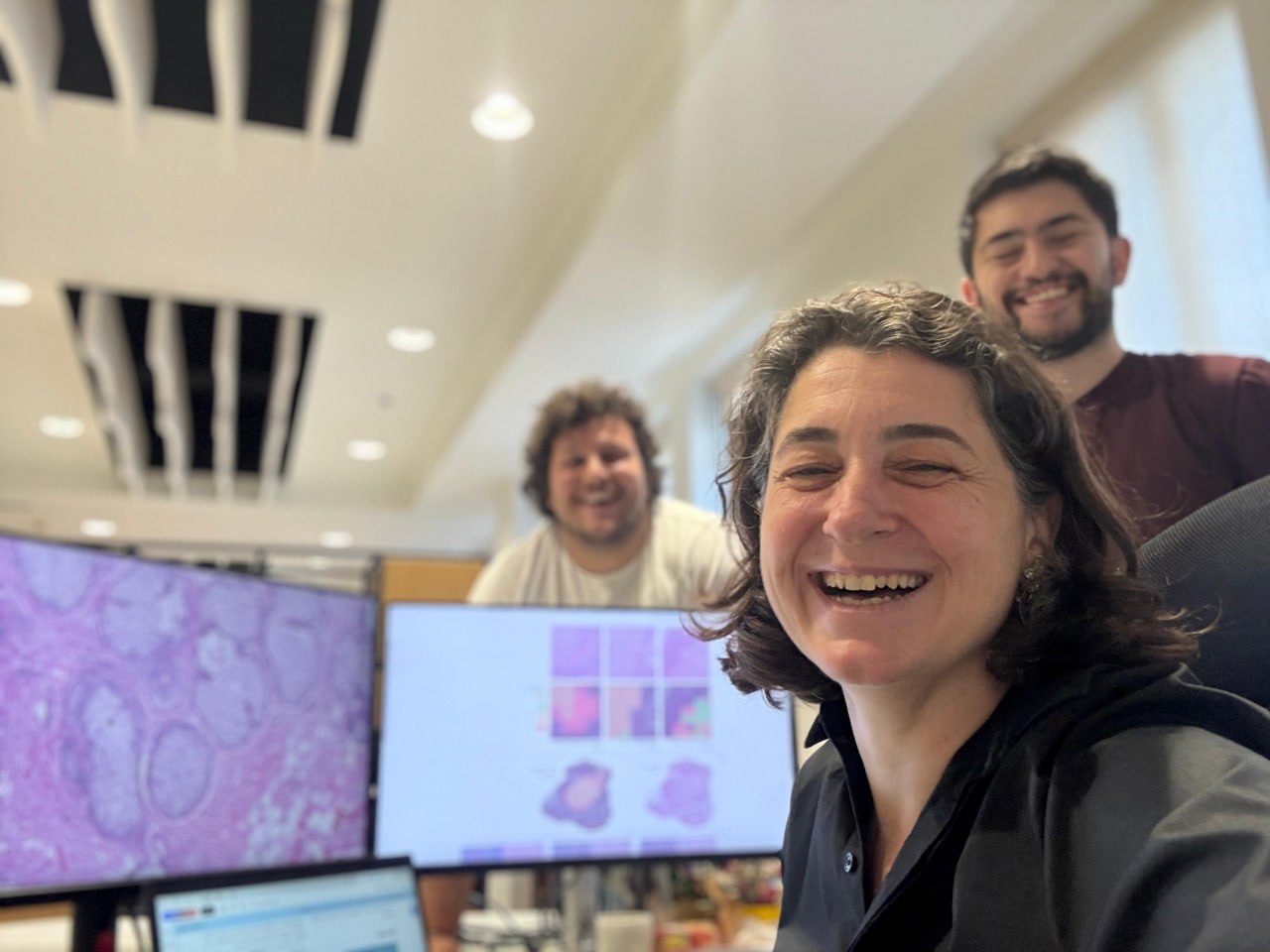

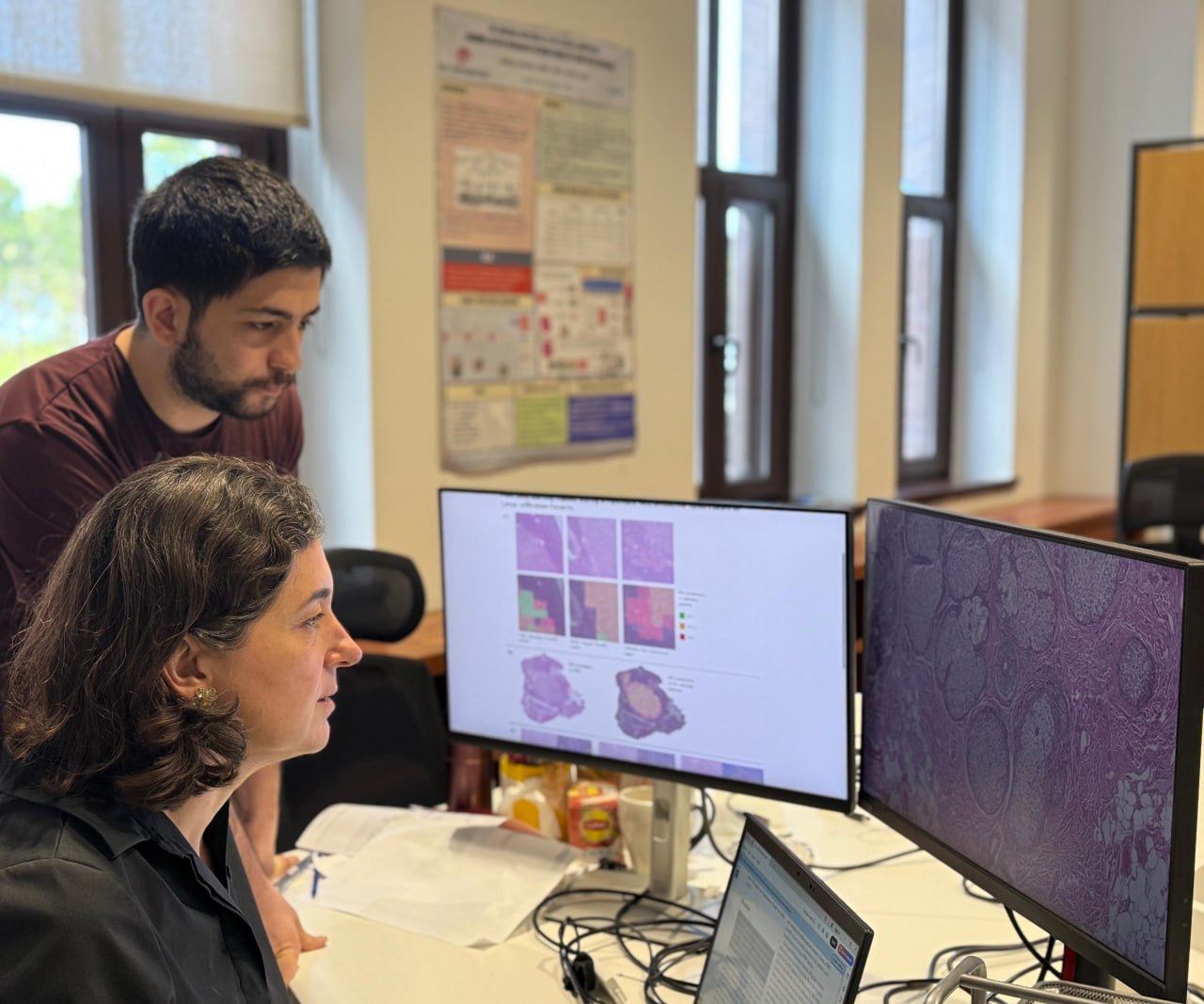

Koç Üniversitesi İş Bankası Yapay Zekâ Uygulama ve Araştırma Merkezi (KUISAI) Direktörü Prof. Dr. Çiğdem Gündüz Demir, yapay zekâya yönelik toplumsal ilginin ve heyecanın farkında olduğunu belirtiyor. Ancak bu teknolojinin, onu geliştirenlerin ve kullananların niyetine bağlı olarak hem yararlı hem de zararlı olabileceğine dikkat çekiyor. İnsanlığın geleceğini şekillendirecek bu teknoloji, büyük beklentilerle birlikte ciddi korkuları da beraberinde getiriyor.

“Yapay Zeka, Geliştiricilerin Niyetine Göre Hem Çok Faydalı Hem de Çok Zararlı Sonuçlar Doğurabilir”

Prof. Dr. Demir, yapay zekâ modellerinin kullanım amacına göre şekillendiğini vurguluyor. “Tıpkı diğer teknolojilerde gibi, yapay zekâ da geliştiricilerin ve kullanıcıların niyetine göre hem çok faydalı hem de çok zararlı sonuçlar doğurabilir. İyi kullanım örnekleri olduğu kadar, kötüye kullanım senaryolarını da zamanla giderek artan şekilde tecrübe edeceğiz.”

En büyük kaygılarından birinin, üretici yapay zekâ araçlarının bilgiye erişimi kolaylaştırırken, bireylerin bilgiyi sorgulamadan kabul etme eğilimini artırması olduğunu belirtiyor. Bu durumun uzun vadede eleştirel ve analitik düşünme becerilerinin zayıflamasına yol açabileceği uyarısında bulunuyor. Bu nedenle yapay zekânın, yalnızca teknolojik olanaklarıyla değil, bu olanakların nasıl kullanıldığıyla da değerlendirilmesi gerektiğini ifade ediyor.

“Yapay Zeka Modelleri İkna Edici Yanlış İçerikler Üretebilir”

İnternetin yaygınlaşmasıyla birlikte insanların teknolojiyi verimsiz kullanma eğilimine dikkat çekildiğinde Prof. Dr. Demir, yapay zekâ için daha kötümser bir senaryonun mümkün olduğunu söylüyor. “Bence bu dediğiniz yine de iyimser bir senaryo, yani sadece tembelliklerin artması. Bugün internette zaten çok fazla yanlış ve yanıltıcı bilgi var; ancak yapay zekâ modellerinin daha da kötü yanı, bu yanlış bilgileri çok daha inandırıcı ve profesyonelce üretebilme potansiyeline sahip olmalarıdır.”

Demir’e göre, yapay zekâ modellerinin sunduğu ikna edici içerikler, özellikle konu hakkında bilgisi az olan kişileri kolayca etkileyebilir. Bu durumun, yanlış bilginin yayılma riskini artırdığını ve zamanla daha da kötüleşeceğini düşündüğünü ekliyor.

“Konunun Temelini Bilmeden Yapay Zeka Kullanmak Yanıltıcıdır”

Yapay zekâdan elde edilen verilerin doğruluğunu kontrol etme ihtiyacı üzerine Prof. Dr. Demir, temel bilginin önemini vurguluyor. “Kesinlikle katılıyorum. Yapay zekâ artık kaçınılmaz bir araç ve birçok alanda kullanımı hız kazanıyor. Kaçınmak mümkün değil, ancak yine de konunun temelini bilmek gerekiyor.”

Örneğin, programlama alanında temel kavramları bilmeden sadece yapay zekâ çıktılarıyla ilerlemenin mümkün olmadığını belirtiyor. “Önce bunları özümsemek, ardından yapay zekâ modellerini anlayarak kullanmak ve çıktılarını eleştirel bir süzgeçten geçirecek kadar bilgi sahibi olmak çok önemli. Aksi takdirde, nasılsa yapay zekâ ‘istediğim’ çıktıları üretiyor diyerek temel kavramları ve prensipleri göz ardı etmek bence en büyük yanılgılardan biri.”

“Yapay Zeka Okuryazarlığı Sadece Ne Yapılabileceğini Değil, Ne Yapılamayacağını da Bilmektir”

Prof. Dr. Demir, yapay zekâdan etkin bir şekilde yararlanmak için sadece onu kullanabilmenin yeterli olmadığını, aynı zamanda sınırlarını ve limitlerini de anlamak gerektiğini söylüyor. “Tasarladığınız bir modeli iyi sonuç üretecek şekilde çalıştırmak kadar, nerede iyi yapamadığını analiz edebilmek de çok değerli. Çünkü bu analiz, söz konusu sorunları aşmak için yeni yöntemler geliştirme fırsatı sunar.”

Bu bağlamda, yapay zekâ okuryazarlığının “ne yapılamaz” sorusunu da içermesi gerektiğini ifade ediyor.

“Teknik Güç Kadar Etik ve Sorumlu Sistemler Geliştirmek de Önemli”

Yapay zekânın kontrolden çıkıp insanlığa zarar verme senaryoları hakkında ise Prof. Dr. Demir, teknolojinin temelinde matematiksel bir fonksiyon olduğunu hatırlatıyor. “SİHA’nın dönüp komuta merkezini vurması gibi bir senaryonun gerçekleşebilmesi için ya doğrudan kötü niyetli bir yapay zekâ modeli oluşturulması ya da bu modelin yanlış veriyle eğitilmesi gerekiyor. Bunun arkasında ise onu geliştiren insan iradesi bulunuyor.”

Bu nedenle, gelecekteki olası çatışmaların yapay zekânın kendi kararlarından değil, onu tasarlayanların niyetlerinden veya sistemdeki açıklardan kaynaklanacağını belirtiyor. “Bu nedenle, teknik olarak güçlü modeller tasarlamak kadar, etik ve sorumlu yapay zekâ sistemleri geliştirmek de büyük önem taşıyor.”

“Mesele Yapay Zekadan Kaçmak Değil, Onu Anlamlı Kullanmaktır”

Yapay zekânın insan gücünü değersizleştireceği endişelerine karşı Prof. Dr. Demir, bu teknolojiden geri dönüşün olmayacağını söylüyor. “Bence esas mesele yapay zekâdan kaçmak değil, onu işimizde ve günlük hayatımızda nasıl daha anlamlı ve verimli kullanabileceğimizi düşünmek.”

Rutin ve tekrarlayan işleri barındıran mesleklerin dönüşüme uğrayacağını, ancak bilişsel yeti, analitik problem çözme ve yaratıcılık gerektiren işlerde nitelikli insan gücüne olan ihtiyacın artarak devam edeceğini öngörüyor. “Bu değişim ve dönüşümden kaçmak bir çözüm değil; buna ayak uydurmanın yollarını düşünmek daha gerçekçi bir yaklaşım olacaktır.”